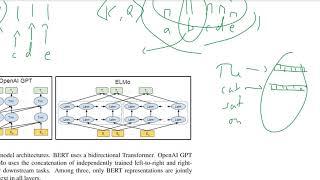

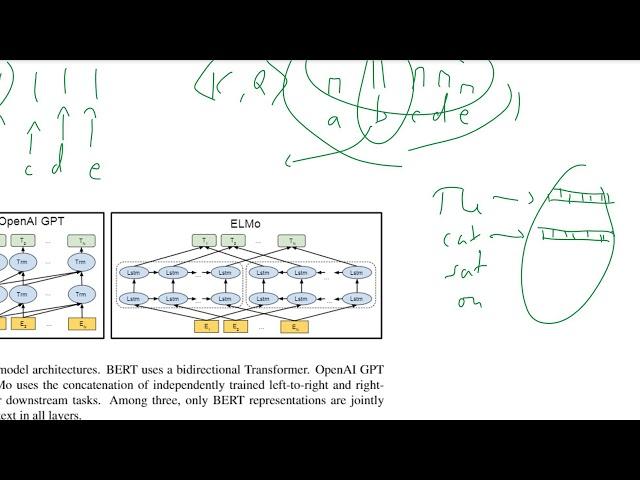

BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding

Комментарии:

2020 Lagoon SIXTY 7 Power Catamaran In-Depth Walkthrough | PART 2: Exterior

The Catamaran Company

Deck the Halls

Christmas 2013 Djs Collective - Topic

Deck the Halls

Brookyn Youth Orchestra - Topic

Deck the Hall Lyrics

Alexis Burrows

Zimt – Schwaches Herz (official)

Tapete Records

Өскемен | УСТЬЕ У ПОДНОЖЬЯ КАМЕННЫХ ГОР

Qazaqstan VIBE